科学技術機械学習(scientific machine learning; SciML)とは,科学研究のためのAI(AI for Science)の1分野であり,AIによって物理現象の計算機シミュレーションやそのためのモデリングを高度化・高速化することを目指します. 特に深層幾何学的力学では,解析力学や微分幾何学,それらを基にした科学技術計算の技術と機械学習を融合します. これによって詳細なメカニズムや方程式が未解明の物理現象(波の伝播や結晶構造の成長など)をデータから自動的にモデル化し,それを用いた高速かつ高精度の計算機シミュレーションを実行にしたり,データから物理法則を発見したりすることを可能にします.

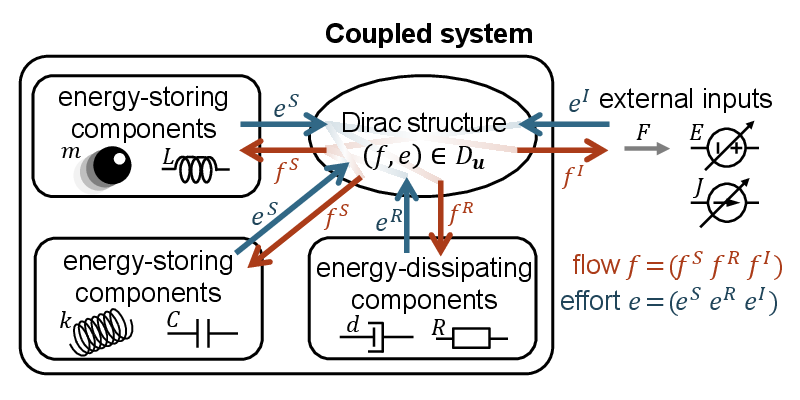

既存の深層学習による物理系のモデル化は,主として機械系を対象としており,またシステム全体を一つの塊として取り扱っていた. そのため,電気系や油圧系といった他のドメインや,それらが結びついた連成系に適用することが難しい. この問題を解決するため,ポート=ハミルトニアン系とポアソン系を統一的に扱うことが可能なポアソン=ディラック系の記述を採用した. これによって,様々な物理ドメインにまたがる力学系を統一的に記述することができるとともに,結合による相互作用や退化を表現することが可能となった.

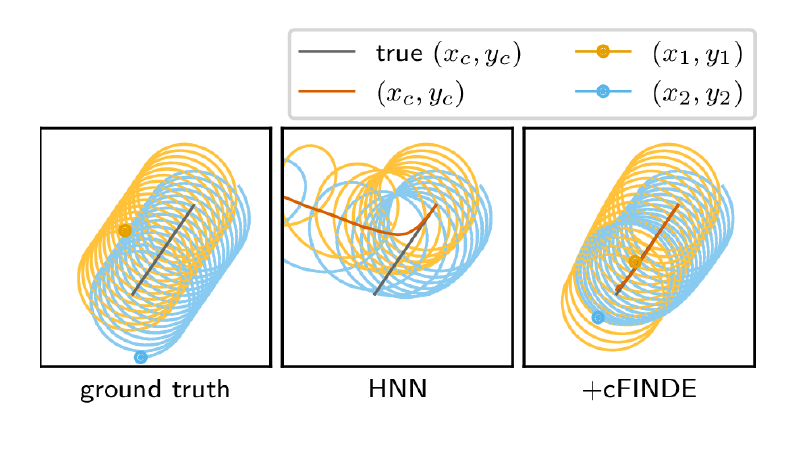

深層学習を用いてデータから物理現象をモデル化する際,例えばハミルトニアンニューラルネットワークのように,既知の物理法則を盛り込むことでモデル化性能を向上させる研究が多く実施されています. しかし,ニューラルネットワークで未知の力学系を学習したい場合,そこに紐づいた法則も未知であることが珍しくなく,どのような手法を使えばよいか明らかではありません. そこで射影法を応用することで,データから様々な種類の保存量を発見し,またそれを保証して高精度に時系列予測を可能にする方法FINDE を提案しました.

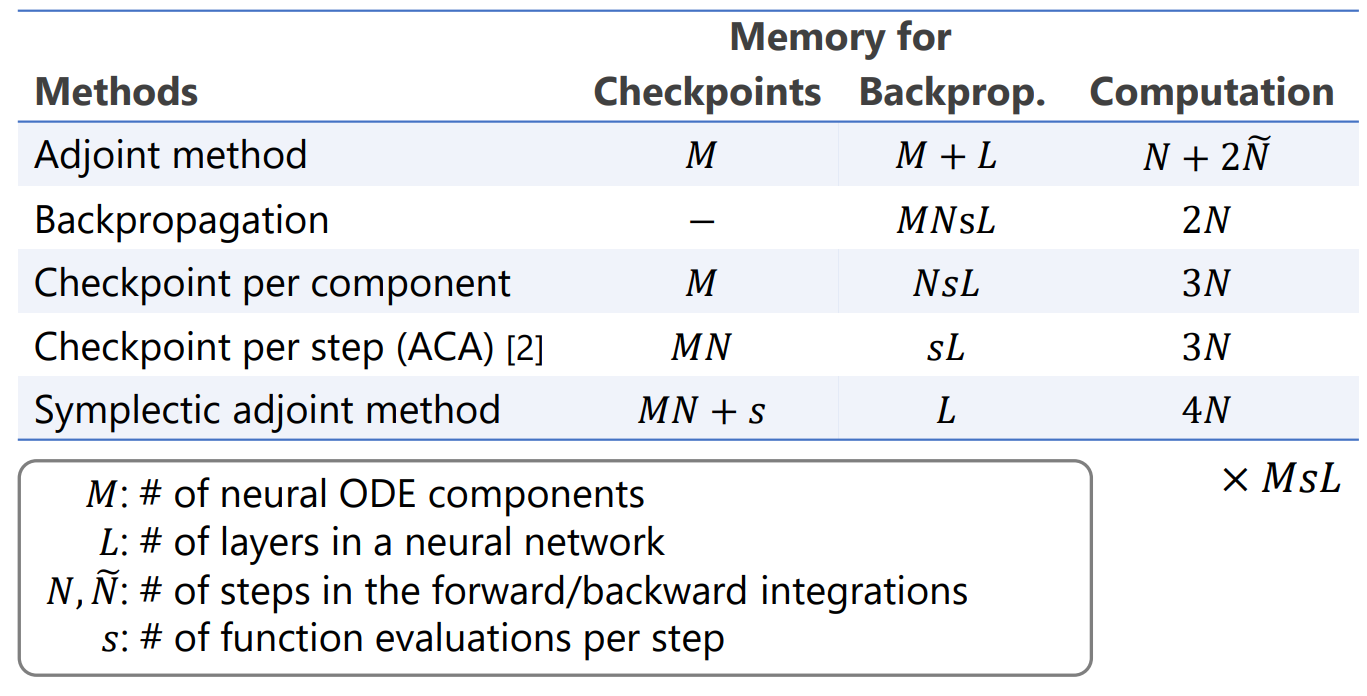

ニューラルネットワークで微分方程式(ODE)を学習するneural ODEは,連続時間の力学系や連続確率密度関数を高い精度でモデル化できます. しかし,同じニューラルネットワークを何度も使うため,誤差逆伝播法で訓練するには非常に大きなメモリが必要になります. 一方で,数値積分で勾配を計算する随伴変数法では,数値誤差を抑えるために今度は大きな計算コストが必要になります. 本研究では随伴変数法に用いる数値積分法をシンプレクティックにすることにより,数値誤差なく勾配が計算できる手法(Sanz-Serna, 2016)をベースに,適切なチェックポイント法を組み合わせることで,省メモリ性と高速な勾配計算を両立させました.

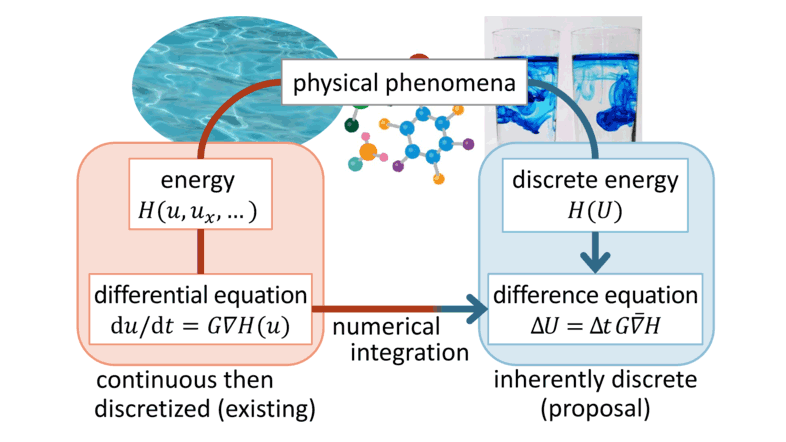

一般に物理現象の支配方程式は連続時間で定義されますが,計算機シミュレーションは離散時間で行わねばならず,この離散化誤差によってエネルギー保存則・散逸則といった物理法則が破綻し,信頼性に欠けた結果を導きます. これを回避するため,離散勾配と呼ばれる数値積分の一種が研究されてきましたが,手動での式変形が必要であり,機械学習に応用することは困難でした. 本研究は自動離散微分という新たなアルゴリズムを提案することで,離散勾配法を深層学習に適用することを可能にしました. これによって深層学習でデータから対象の力学系を学習し,エネルギーの保存則・散逸則を厳密に保つシミュレーションを行うことが可能になりました.

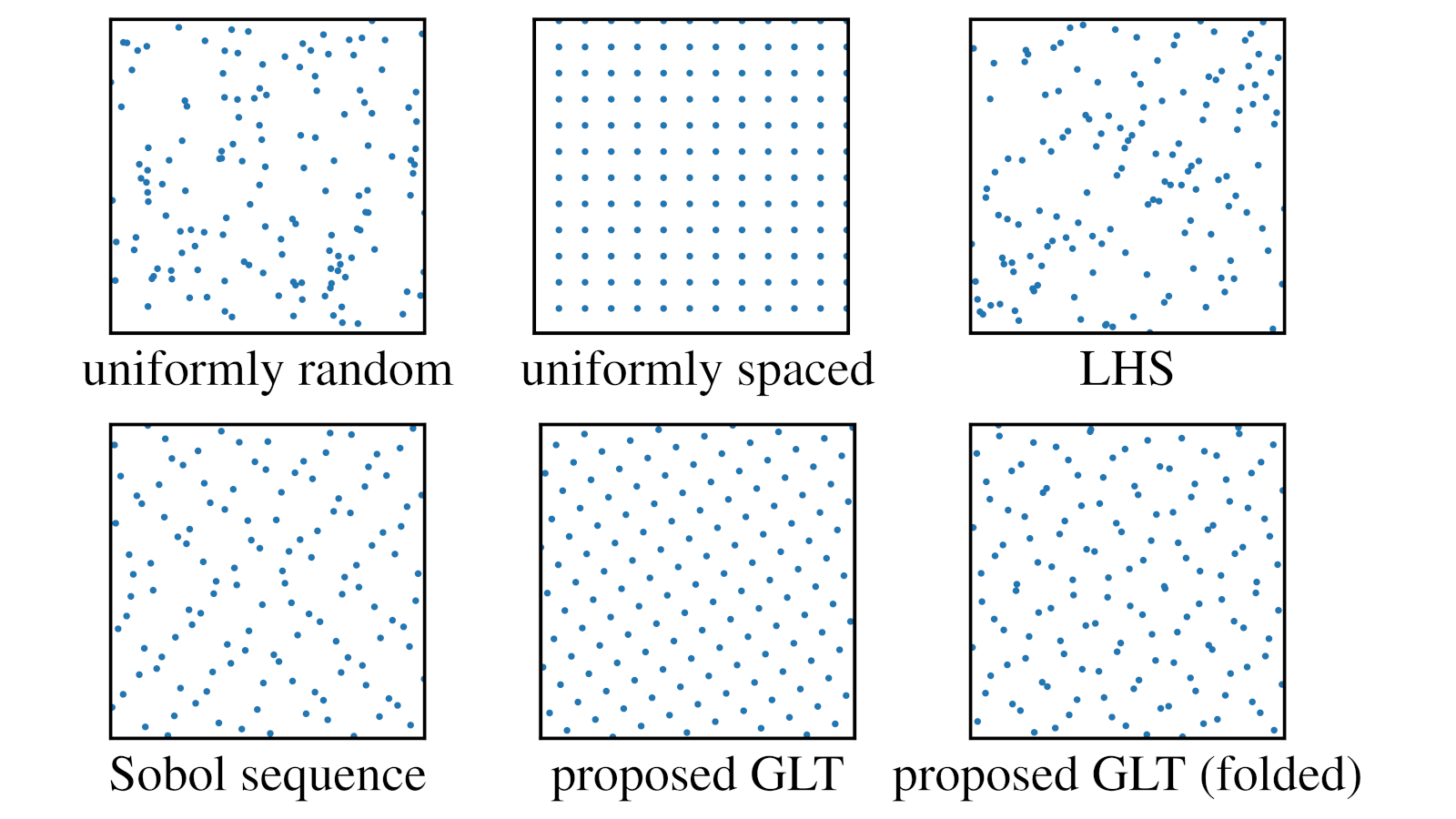

Physics-informed neural networks (PINNs)は,偏微分方程式(PDE)の解を表現する基底関数としてニューラルネットワークを用いる手法であり,柔軟な解の表現や逆問題への拡張が容易に可能です. PINNsでは,有限個の評価点上でPDEが満たされるするようにネットワークを学習するため,連続空間上の誤差を離散的に評価せざるを得ず,評価点の選び方が学習効率や精度に直結します. 本研究では,数論的アプローチに基づく優良格子点法をPINNsに適用し,その前提を満たすための複数のテクニックも合わせて提案しました. これによって,低次元のPDEでは2~7倍程度学習を高速化することができました.